Chat GPTをはじめとした、生成AIを活用する場合のリスクとは

米OpenAI社が2022年11月に公開したChatGPTは、わずか2ヶ月後の2023年1月にアクティブユーザー数が1億人に達し、日本でもChatGPTIの利用が2023年4月中旬で746万/日アクセスと急速に関心が進んでいます。しかし、一方で生成AIには著作権違反やサイバーセキュリティなどのリスクが潜んでおり、各省庁がガイドラインを出すなど社会問題化しています。

たとえば、2023年5月22日、米国防総省付近で爆発が起きたとする偽の画像がSNS上で拡散され、一時的に金融市場が混乱したという事件が起こりました。生成AI利用に関する国際的議論が巻き起こる中でそのリスクが露わになった出来事となりました。

AIは適切な利用により、企業のイノベーションや生産性向上、能力開発などに資する技術ですが、一方でこういったリスクを企業が管理するべき段階に入っています。

そこで本記事では、ChatGPTの利用リスクやその対策方法について解説します。Chat GPTをはじめとした生成AIを利用する上でのリスクは共通していますので参考にしてください。

ChatGPTの利用背景

ビジネスにおける生成AIの利活用は広がりを見せており、一部を紹介します。

- ・カスタマーサポートのトラブルシューティング支援

- ・マーケティングのニーズ調査等

- ・スケジュール調整やドキュメント生成の自動化

- ・製品開発やデザイン等のアイデアやアドバイスを行う

例えば、ChatGPTを使いこなすにはプロンプトエンジニアリングと呼ばれる、プログラム開発のようなスキルが求められるものの、ストレスなく対話し要求された返事を返します。

これまで時間をかけて行っていた煩雑な作業や時間がかかる作業を、短時間で応えてくれる素晴らしいサービスと言えます。

生成AI利用時のリスク

では、生成AIのリスクとは何でしょうか。ここでは、情報セキュリティに関して利用時に影響の大きい、以下の3点をピックアップして解説します。

情報漏えいリスク

ChatGPTは、利用を禁止する企業があります。その理由としてユーザーと会話した内容を常に学習し、他のユーザーへの回答に利用します。そして対話の内容や情報は保存され、学習に利用され続けることがあります。

例えば、個人情報を分析等のために学習させると、悪意あるユーザーによって学習した個人情報を盗まれてしまうかもしれません。もし近い将来にIoT体重計がマルウェアに感染しそこから体重情報が盗まれたら悪意あるユーザーがうっかりChatGPTに学習させてしまう、なんてこともあるかも知れません。

著作権抵触リスク

ChatGPTが既存の著作物や知的財産を学習している場合、著作権法や関連法規に抵触している可能性があります。文章生成させたら、ユーザーとの対話によってインターネットに公開されている情報や利用の禁止を知らないユーザーによる提供著作物から学習していることは十分考えられます。

例えば、ある小説の評判に関するブログ記事をChatGPTに生成させようとしたとします。まだ国内では事例があまりありませんが、小説を引用した記事を生成してしまい著作権に関する訴訟を受けることもあるかも知れません。もしかしたら、この記事もChatGPTで生成しているかも知れませんが。

誤情報利用リスク

ChatGPTはユーザーとの対話により学習し他ユーザーとの対話に利用します。学習した情報が誤っていれば、誤った回答をし続ける可能性もあります。つまり回答の内容が本当に正しいか確認する必要があります。

あるユーザーが地方の小さな駅で最終電車を逃してしまい近くの休憩場所を探しました。ChatGPTに聞いたところ、その住所に向かったらそもそもそこは建物ですらなかったという事がありました。結局そのユーザーはGoogleマップで宿を探したそうです。頑張って歩いたのに何もなかったらトラウマになってしまうかも知れません。

生成AIリスク対策

ChatGPTは便利な反面とても危うい仕組みであることはご理解頂けたと思います。上手に付き合っていくためには先に挙げた3つのリスクについて、対策のポイントがありますので見ていきましょう。

情報漏えい対策

ChatGPT利用に関する情報漏えい対策は、利用ルールの作成とガイダンスです。全体のリスクに言えることですが省庁のガイドラインにもあるように、まずは対象となるお客様情報や社内の機密情報等を定義しChatGPTでそれらを入力しない等のルールを作成しましょう。次にそのルールを全社に周知し守るよう教育を実施していきましょう。

著作権抵触対策

著作権の問題はすでにインターネットに公開されている画像や文章の二次利用に関するトラブル事例から、法的な問題があるため利用する際は注意しましょう。警察が突然やってきたという状況を避けるためにも法律の専門家によるアドバイスを受ける必要があります。

誤情報対策

ChatGPTの回答は万能ではありません。あくまでもユーザー側の責任としてChatGPTの回答が正しいか根拠を確認し、前提となる条件が無視されていないか検証する必要があります。情報の正確性や信頼性は私たち同様、外部のお客様やステークホルダーも同様と考えていくことが重要です。

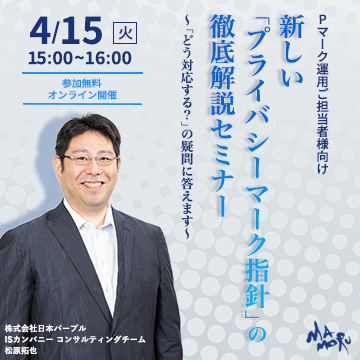

ガイドラインの作成について

現在、各省庁でガイドラインを作成しており、年末には統合される予定です。これらのガイドラインから自組織へのルールへ落とし込む場合、様々な規定類との整合性が必要になる場合があります。弊社ではISMS(ISO27001)認証やプライバシーマークの認証コンサルティングを行っており、規定類の作成に精通しています。

様々な事情に合ったルールを作成し、必要に応じてガイダンスを実施することも可能です。ChatGPTのシャドーIT利用にお困りならぜひご依頼頂ければと思います。

今回は数あるサービスの中から、多くのコンサルティングの実績を持つ「Coach Mamoru(コーチマモル)」をご紹介します。

情報セキュリティコンサルティング「Coach Mamoru」

Coach Mamoruはこれまでに多数の実績を持つ、信頼できるコンサルティングサービスです。課題の把握から運用、定着までを一括してサポートしており、企業の課題に合わせてサービス内容を柔軟にカスタマイズすることが可能です。経験豊富なコンサルタントが最新の知識・トレンドを含めた最善の支援を提供し、組織文化の構築に貢献するとしています。

お客様のご事情に合わせて経験豊富なコンサルタントが最新の知識・トレンドを含めた最善の支援を提供し、組織文化の構築や事業成長に貢献いたします。

ChatGPT以外でも機密情報の管理や従業員教育といった情報セキュリティにまつわる多様なサービスを提供しており、あらゆる情報リスクから企業を守るプロといえるでしょう。今回ご紹介した生成AIを含め、情報セキュリティに関する課題や進め方にお困りの場合は、一度相談してみてはいかがでしょうか。

※生成AI利用についてのガイドラインは今後もアップデートが予測されるため、必要に応じて本記事も更新していく予定です。